© Forus

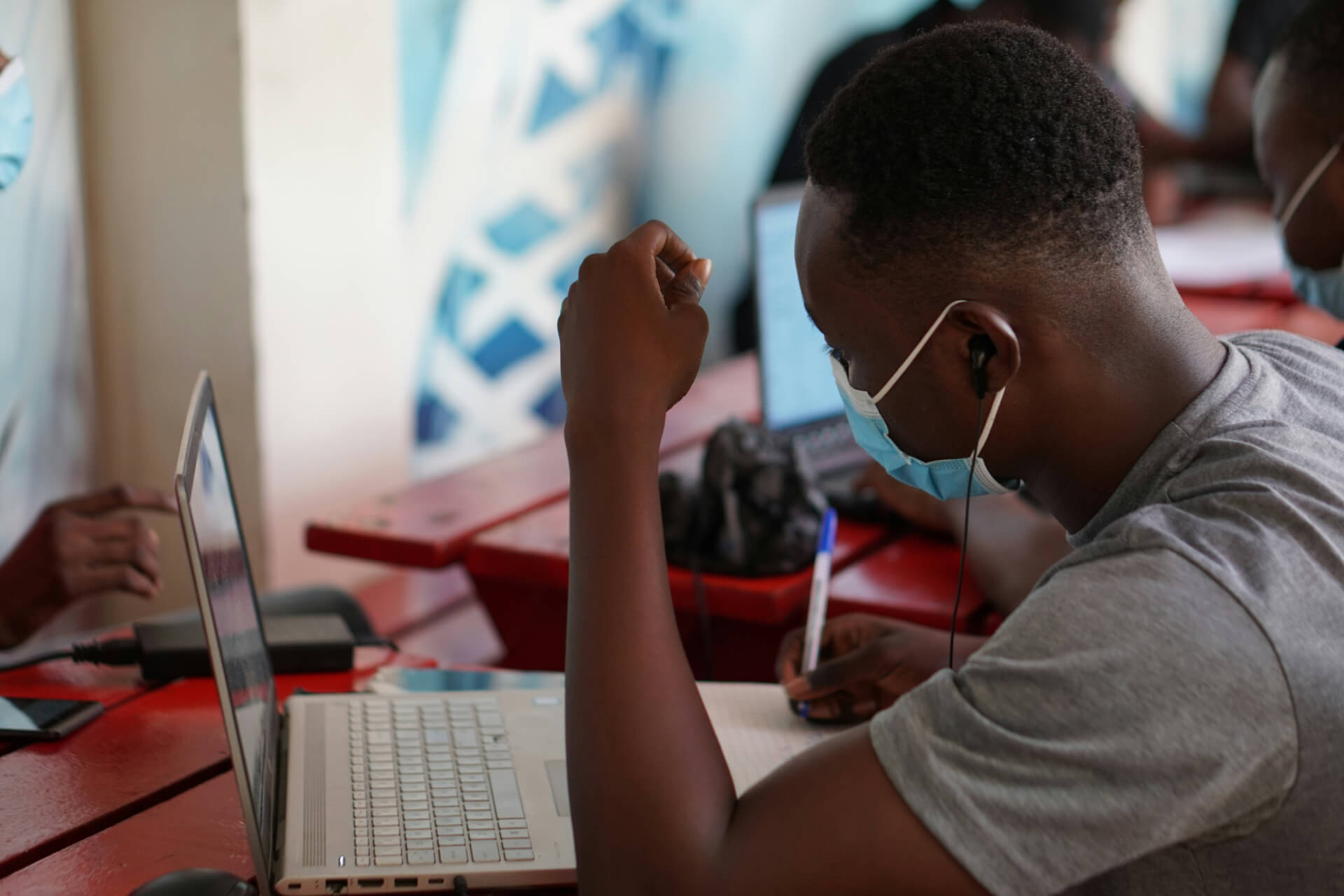

(c)Boitumelo

2026-03-02

Quando a democracia é alvo de deepfake À medida que seis nações africanas se preparam para as eleições de 2027, a desinformação gerada por IA já está a remodelar o campo de batalha eleitoral.

O vídeo espalhou-se rapidamente — e de forma convincente. Nele, o presidente nigeriano Bola Ahmed Tinubu está diante de um microfone, com dois homens ao seu lado, e dirige-se a uma multidão invisível. «Sou fã do Chelsea», diz ele, «e estou a planear comprar do seu proprietário». O clipe acumulou milhares de partilhas antes que alguém parasse para fazer a pergunta óbvia: ele realmente disse isso?

Não disse. A filmagem foi gerada por IA — um deepfake. E embora essa fabricação em particular fosse relativamente inofensiva, aqueles que a viram se espalhar em tempo real compreenderam algo significativo: a tecnologia para colocar palavras convincentes na boca de um presidente havia chegado à política nigeriana. As eleições de 2027 ainda estão por vir. O verdadeiro teste ainda não começou.

Com seis nações africanas — Nigéria, Quénia, Angola, Gâmbia, Guiné Equatorial e República do Congo — a caminho das urnas em 2027, o continente enfrenta o seu ciclo eleitoral mais complexo tecnologicamente até à data. O conteúdo deepfake cresceu 550% entre 2019 e 2023, de acordo com um relatório da Deloitte de janeiro de 2025. Ferramentas de IA que antes exigiam conhecimento especializado agora podem produzir vídeos e áudios sintéticos convincentes em minutos. O campo de batalha político está a ser silenciosamente remapeado.

A Nigéria não está à espera que o pior aconteça — já está a viver os sinais de alerta. Em junho de 2025, um vídeo deepfake em formato de noticiário circulou online alegando que soldados nigerianos estavam a guardar gado de forma VIP em Yelwata, no estado de Benue. O vídeo surgiu poucos dias depois de um ataque noturno na mesma cidade ter deixado mais de 100 mortos. A filmagem fabricada — desmentida pela PRNigeria — chegou a uma comunidade já devastada pela dor, com o objetivo de inflamar as tensões entre as comunidades agrícolas e pastorais, que há muito são fonte de conflitos mortais.

No mesmo mês, um clipe gerado por IA do presidente dos EUA, Donald Trump, supostamente falando sobre a vida nacional nigeriana, o petróleo e as forças armadas, foi partilhado no TikTok. Ele obteve mais de 421.500 visualizações.

Estes não são incidentes isolados. São uma antevisão.

«Em 2019, eram falsificações baratas; em 2023, eram edições e legendas falsas. Hoje, enfrentamos vozes e vídeos hiper-realistas que os cidadãos comuns dificilmente conseguem distinguir da realidade.»

— Dr. Chinonso E. Okoye, assistente especial sénior do governador do estado de Anambra para segurança cibernética e infraestruturas

Num país onde 62% das pessoas acedem às notícias políticas através das redes sociais e onde a arquitetura de encaminhamento encriptado do WhatsApp faz com que o conteúdo viaje mais rápido do que as correções conseguem acompanhar, isso não é apenas um problema tecnológico. É um problema democrático.

«Muitos eleitores conseguem identificar manipulações simples de fotos», diz Victoria Oladipo, fundadora da Learn Politics. «Mas deepfakes, áudio gerado por IA ou imagens hiper-realistas são muito mais difíceis de detectar. Na Nigéria, onde a confiança em imagens e gravações de voz é alta, isso torna os eleitores particularmente vulneráveis.»

NNNGO — a principal plataforma da sociedade civil da Nigéria e membro da Forus International — tem alertado sobre essas vulnerabilidades estruturais. Com uma base de mais de 4000 organizações membros e conteúdo digital que atinge 2,5 milhões de pessoas anualmente, a NNNGO situa-se na intersecção entre a responsabilidade comunitária e a defesa da democracia. O seu trabalho de 2025 sobre o espaço cívico e a proteção digital documentou preocupações crescentes sobre o ambiente propício para a sociedade civil durante os períodos eleitorais — incluindo os riscos que a desinformação gerada por IA representa para a confiança cívica e a credibilidade do setor.

O panorama continental

A Nigéria é a maior democracia de África, mas está longe de ser o único país a enfrentar esta ameaça. À medida que o ciclo eleitoral de 2027 se aproxima, o padrão em todo o continente é consistente: o conteúdo gerado por IA está a ser utilizado como arma para amplificar as tensões étnicas, personificar líderes e saturar o ambiente de informação com uma realidade fabricada.

No Quénia, que também vai às urnas em 2027, pesquisadores do Trust Lab — um projeto financiado pela UE — identificaram 17 grandes campanhas coordenadas de desinformação em operação somente em 2025, muitas com sobreposições significativas entre as campanhas, revelando redes organizadas. Vídeos deepfake e documentos falsificados foram utilizados para inflamar divisões étnicas, visando particularmente a comunidade Kikuyu. Numa operação, uma nota técnica falsa atribuída à Fundação Internacional para Sistemas Eleitorais alegava falsamente que a influência dos eleitores tinha mudado para condados minoritários — uma invenção destinada a fragmentar as coligações eleitorais.

As eleições de 2024 no Gana ofereceram um caso de estudo preocupante sobre como a desinformação impulsionada pela IA se cruza com a instabilidade eleitoral. Redes de bots, meios de comunicação manipulados e conteúdo deepfake foram utilizados para distorcer narrativas durante a campanha eleitoral. E nas eleições presidenciais de 2024 na Roménia — um caso exemplar que repercutiu globalmente — os resultados eleitorais foram anulados após o surgimento de evidências de interferência impulsionada por IA usando vídeos manipulados, demonstrando o que acontece quando a mídia sintética não é apenas ruído, mas uma intervenção decisiva em um resultado democrático.

O que torna o contexto africano distinto é a velocidade com que a desinformação se propaga por comunidades com acesso limitado a infraestruturas formais de verificação e a fragilidade política do terreno em que ela se instala. As eleições em todo o continente já são eventos nacionais tensos, ensombrados por receios de manipulação, violência e agitação pós-eleitoral. A introdução de meios de comunicação sintéticos gerados por IA neste ambiente não se limita a adicionar um novo tipo de informação falsa — ela potencializa as vulnerabilidades existentes.

As plataformas membros da Forus em toda a África — incluindo na Nigéria, Senegal, Gana e Quénia — estão integradas nos ecossistemas cívicos mais expostos à manipulação eleitoral impulsionada pela IA. Como documentado pelo monitoramento do ambiente facilitador da Forus International, a repressão digital e a desinformação estão agora entre as principais ameaças ao espaço cívico durante os ciclos eleitorais. As suas redes fornecem a infraestrutura de alerta precoce e a confiança da comunidade que os governos nacionais e as empresas de tecnologia não podem replicar sozinhos.

O algoritmo é a arquitetura

Por trás de cada deepfake que se torna viral está algo igualmente poderoso e muito menos visível: um algoritmo que decidiu amplificá-lo. Em toda a África Ocidental e além, os algoritmos de redes sociais alimentados por IA substituíram efetivamente as redações tradicionais como guardiãs do discurso político. Estas plataformas, impulsionadas por métricas de engajamento, favorecem sistematicamente conteúdos que provocam respostas emocionais poderosas — do tipo que mais provavelmente suscitará um like, um compartilhamento ou um comentário furioso.

A consequência é estrutural. Conteúdos sensacionalistas ou emocionalmente manipuladores superam reportagens matizadas, não porque o público seja crédulo, mas porque a arquitetura financeira das plataformas recompensa a viralidade em detrimento da veracidade. Esta «economia da atenção» cria a infraestrutura perfeita para a desinformação gerada por IA prosperar. Uma campanha coordenada de desinformação não precisa enganar toda a gente. Basta criar ruído suficiente para confundir o ambiente informativo, minar a confiança em fontes legítimas e ampliar as fraturas sociais existentes.

A ameaça não é puramente interna. Uma rede de desinformação financiada pela Rússia, descoberta antes das eleições parlamentares de 2025 na Moldávia, pagou a fábricas de engajamento — inclusive na África — para promover narrativas alinhadas com o Kremlin por meio de contas verificadas nas redes sociais. A lição: na era das operações de influência habilitadas pela IA, a linha entre interferência estrangeira e desinformação interna tornou-se difícil de traçar. Pesquisas indicam que 60% das campanhas de desinformação direcionadas à África são patrocinadas por estrangeiros, principalmente da Rússia, China e países do Golfo, com a África Ocidental arcando com o maior fardo desses ataques.

Mulheres na mira

Se os deepfakes representam uma ameaça geral à integridade eleitoral, eles representam uma ameaça específica e distintamente de género para as mulheres na política. Nas eleições africanas no Gana, Namíbia e Senegal, o conteúdo gerado por IA foi utilizado não apenas para desacreditar politicamente as mulheres políticas, mas para destruí-las pessoalmente — por meio de imagens sexuais fabricadas, escândalos inventados e conteúdo projetado para humilhar, em vez de debater.

Um relatório de 2025 da Tanda Community Network, com base em grupos focais e entrevistas com mulheres políticas e jornalistas em três países africanos, descobriu que os ataques deepfake causam danos socioculturais, profissionais e psicológicos duradouros — e que a violência frequentemente se espalha para espaços offline. No Quénia, em 2025, uma campanha difamatória usando um vídeo gerado por IA visando Dorcas Gachagua, esposa do ex-vice-presidente Rigathi Gachagua, obteve mais de 163.000 visualizações — com o objetivo de humilhar o marido e prejudicar a sua reputação por meio de ataques a ela.

«O assédio online terá um custo mais elevado para as mulheres políticas, porque esse assédio se manifesta não apenas em ataques à competência política, mas também numa rejeição cultural das mulheres. As candidatas já dispõem de recursos financeiros insuficientes para combater a desinformação sexualizada e baseada no género.»

— Lucy Purdon, fundadora e diretora, Courage Everywhere

Esta assimetria não é acidental. As mulheres enfrentam críticas que visam a sua aparência, vida familiar e escolhas pessoais de maneiras que os seus colegas homens raramente enfrentam. Os deepfakes amplificam essas formas de ataque baseadas no género, tornando-as hiper-realistas e devastadoramente compartilháveis. O resultado é um efeito assustador sobre a participação política das mulheres, que opera de forma silenciosa, mas poderosa. Em vários contextos africanos, as evidências já apontam para o afastamento das mulheres da vida pública, em vez de suportarem o custo do assédio digital.

A contraofensiva

As defesas estão a ser construídas — mas contra uma ameaça que se move mais rapidamente do que as instituições.

A comissão eleitoral da Nigéria, INEC, fez história em maio de 2025 ao estabelecer uma Divisão de Inteligência Artificial dedicada, com a missão de melhorar a tomada de decisões, o envolvimento dos eleitores e combater a desinformação. É um passo significativo. Mas Kingsley Owadara, especialista em ética da IA e fundador do Centro Pan-Africano para a Ética da IA, argumenta que a criação estrutural é apenas o começo. «É necessário investir na formação de funcionários eleitorais, especialistas em cibersegurança e verificadores de factos», afirma. «É fundamental educar o eleitorado sobre a desinformação da IA. E as plataformas devem ser responsabilizadas pela remoção rápida de conteúdos manipulados.» Ele descreve uma resposta em três camadas: restringir os modelos de IA de gerar propaganda prejudicial; detetar conteúdos sintéticos com ferramentas forenses e de proveniência; e intensificar os protocolos de remoção com a captura de provas. Ele admite que a verificação continua a ser uma lacuna: «Nenhum detetor é totalmente fiável, uma vez que os geradores evoluem.»

O quadro jurídico está ainda mais atrasado. A Secção 123 da Lei Eleitoral de 2022 da Nigéria proíbe a publicação de declarações falsas sobre candidatos — uma infração punível com uma multa de 100 000 nairas ou seis meses de prisão. Mas o estatuto foi concebido para um mundo pré-IA. Não leva em conta vídeos sintéticos, clonagem de voz ou a velocidade com que o conteúdo gerado por IA circula. As Filipinas, por outro lado, introduziram requisitos para que os candidatos divulguem o uso de IA em materiais de campanha antes das eleições de maio de 2025, designando deepfakes como uma ofensa eleitoral. A lacuna regulatória da Nigéria é significativa.

As redes de verificação de factos de base surgiram como uma linha de defesa vital, mesmo com a sua capacidade sobrecarregada. Organizações como a Dubawa e a FactCheckAfrica estão a monitorizar ativamente o conteúdo político gerado por IA antes de 2027. Mas estas organizações estão a competir com a economia dos meios de comunicação sintéticos em desvantagem fundamental: a desinformação é barata de produzir, emocionalmente atraente e espalha-se por canais encriptados onde não pode ser combatida em tempo real.

As plataformas da sociedade civil dentro da rede Forus — incluindo a rede de 4.073 membros da NNNGO que abrange todas as seis zonas geopolíticas da Nigéria — estão em uma posição única para preencher essa lacuna. Em 2025, a NNNGO realizou um mapeamento da sociedade civil e avaliações de capacidade, avaliando as capacidades de proteção digital de todos os seus membros. As suas conclusões confirmaram o que as organizações da linha da frente já sabiam: o setor precisa de investimento urgente em literacia em IA, segurança digital e resposta em tempo real à desinformação. Estas não são exigências políticas abstratas — representam as condições de que a sociedade civil precisa para funcionar como última linha de defesa da democracia em 2027 e além.

A exceção da África do Sul — e o que ela nos ensina

Nem todas as eleições na África nos últimos anos foram remodeladas pela desinformação impulsionada pela IA. As eleições de 2024 na África do Sul ofereceram uma conclusão contraintuitiva: a pesquisa encontrou presença limitada de desinformação impulsionada pela IA, com a maioria das informações erradas originando-se de fontes tradicionais. A confiança do público na mídia permaneceu relativamente resiliente, sem declínio notável relacionado ao conteúdo gerado por IA, além de casos isolados de deepfakes. A infraestrutura de mídia relativamente robusta do país — incluindo um ecossistema maduro de verificação de fatos e uma liberdade de imprensa mais forte do que a maioria das nações africanas — forneceu amortecedores estruturais.

A lição não é que a IA não representa uma ameaça à democracia sul-africana, mas que o impacto da desinformação gerada por IA não é uniforme. Ele é mediado pela força das instituições existentes, pela qualidade da infraestrutura de mídia e pelo nível básico de confiança do público nos processos democráticos. A Nigéria e o Quénia entram em 2027 sem esses amortecedores. Na Nigéria, 63% dos inquiridos após as eleições de 2023 expressaram falta de confiança na contagem de votos da INEC. Esse défice de confiança é o ambiente em que a desinformação gerada pela IA será divulgada.

Corrida contra o tempo

As eleições de 2027 em África não serão decididas apenas pela IA. Mas as escolhas feitas nos próximos dois anos — investir em alfabetização digital em grande escala, responsabilizar as plataformas legalmente, fornecer recursos aos verificadores de factos com capacidades em tempo real e estabelecer protocolos nacionais para conteúdo político gerado por IA — determinarão se essas eleições serão decididas pelos cidadãos ou por algoritmos.

«Em 2019, eram falsificações baratas; em 2023, eram edições e legendas falsas. A escalada não está a abrandar.»

— Dr. Chinonso E. Okoye

A tecnologia para fabricar a desistência de um candidato de uma corrida eleitoral, clonar a voz de um comissário eleitoral ou gerar um vídeo no formato de noticiário alegando fraude eleitoral existe hoje. A questão não é se ela será usada em 2027, mas se as instituições democráticas serão rápidas o suficiente — e estarão suficientemente equipadas — para manter a linha quando isso acontecer.

Para a sociedade civil, os riscos vão além de uma única eleição. Como documentado pelo próprio Forus International em seu monitoramento do ambiente propício, as eleições são os momentos em que a pressão sobre as organizações da sociedade civil se intensifica mais acentuadamente — prisões, fechamentos, assédio e, agora, mídia sintética projetada para desacreditar os próprios atores cívicos. As organizações que estão atentas aos deepfakes são as mesmas que lutam pelo espaço para existir. Essa luta não pode ser separada da luta pelo voto.

Só se pode contar votos. Mas, primeiro, é preciso proteger a verdade.

Este artigo foi escrito como parte do programa de bolsas de jornalismo da Forus. Saiba mais aqui